AI代理记忆系统深度解析:从持久化到上下文管理的技术实践 🧠🤖

发布日期: 2026-04-29

技术领域: 人工智能、代理系统、系统架构

目标读者: AI工程师、系统架构师、技术爱好者

🧠 概述

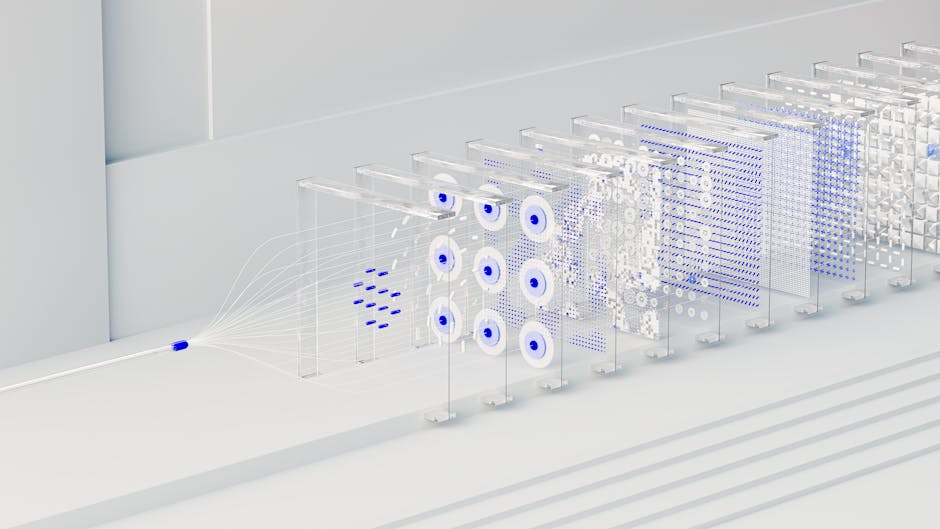

AI代理的记忆系统是决定代理智能水平的关键基础设施。一个没有记忆的AI代理就像一个患有严重失忆症的人类——每次对话都需要重新认识世界。本文将深入探讨AI代理记忆系统的核心技术架构、持久化策略、上下文管理机制以及实践经验。

{: style="max-width: 100%; border-radius: 8px; box-shadow: 0 4px 8px rgba(0,0,0,0.1);"}

{: style="max-width: 100%; border-radius: 8px; box-shadow: 0 4px 8px rgba(0,0,0,0.1);"}

🔧 记忆系统的核心架构

现代AI代理的记忆系统通常采用分层架构设计,模拟人类记忆的多层结构:

class AgentMemorySystem:

"""AI代理记忆系统的核心架构"""

def __init__(self):

# 工作记忆 - 短期上下文,当前会话中的临时信息

self.working_memory = WorkingMemory(capacity=4096)

# 情景记忆 - 会话日志,最近对话和事件的记录

self.episodic_memory = EpisodicMemory(retention_days=30)

# 语义记忆 - 长期知识,经过提炼的事实、技能和偏好

self.semantic_memory = SemanticMemory()

# 程序记忆 - 操作流程,经过验证的工作流和技能

self.procedural_memory = ProceduralMemory()

def process_query(self, query: str) -> str:

"""处理用户查询,整合多层记忆"""

context = self.working_memory.get_context()

relevant_semantic = self.semantic_memory.search(query)

recent_episodes = self.episodic_memory.get_recent(limit=5)

return self._generate_response(query, context, relevant_semantic, recent_episodes)

1. 工作记忆(Working Memory)

工作记忆是AI代理的"短期缓冲区",存储当前会话中的即时上下文:

class WorkingMemory:

"""工作记忆 - 当前会话的短期上下文"""

def __init__(self, capacity: int = 4096):

self.capacity = capacity

self.buffer = []

self.token_count = 0

def add(self, item: dict) -> None:

"""添加上下文项,自动管理容量"""

self.buffer.append(item)

self.token_count += item.get('tokens', 0)

# 超容量时进行压缩

while self.token_count > self.capacity:

removed = self.buffer.pop(0)

self.token_count -= removed.get('tokens', 0)

def compress(self) -> dict:

"""压缩工作记忆为摘要"""

if not self.buffer:

return {}

return {'summary': self._summarize(self.buffer), 'key_points': self._extract_key_points(self.buffer)}

关键特性:

- 容量管理:基于Token数量限制,避免超出模型上下文窗口

- 自动压缩:超容量时通过摘要和关键点提取进行压缩

- 优先级排序:重要信息(用户指令、关键数据)优先保留

2. 情景记忆(Episodic Memory)

情景记忆记录代理的"人生经历"——每一次会话的历史:

class EpisodicMemory:

"""情景记忆 - 会话历史记录"""

def __init__(self, retention_days: int = 30):

self.retention_days = retention_days

self.storage = FileBasedStorage(base_path='~/.agent/memory/')

def save_session(self, session_data: dict) -> str:

"""保存会话记录"""

date = datetime.now().strftime('%Y-%m-%d')

filename = f'{date}-{session_data["session_id"]}.md'

# 结构化的会话记录格式

content = self._format_session(session_data)

self.storage.write(filename, content)

return filename

def search(self, query: str, limit: int = 5) -> list:

"""搜索相关历史会话"""

# 使用全文检索(如FTS5)搜索历史记录

return self.storage.search(query, limit=limit)

def get_recent(self, limit: int = 3) -> list:

"""获取最近的会话摘要"""

files = sorted(self.storage.list_files(), reverse=True)[:limit]

return [self._read_summary(f) for f in files]

技术实现要点:

- 文件系统存储:使用时间戳命名的文件,便于排序和归档

- 全文搜索:集成FTS5等搜索引擎,支持跨会话检索

- 会话摘要:为每个会话生成摘要,便于快速回顾

- 生命周期管理:自动清理超过保留期的旧记录

3. 语义记忆(Semantic Memory)

语义记忆是AI代理的"长期知识库"——经过提炼和固化的事实、技能和用户偏好:

class SemanticMemory:

"""语义记忆 - 长期知识库"""

def __init__(self):

self.knowledge_base = {

'user_profile': {}, # 用户偏好和身份信息

'skills': {}, # 已学习的技能和工作流

'facts': {}, # 持久化的事实性知识

'conventions': {} # 编码规范和约定

}

self.index = VectorIndex()

def remember(self, key: str, value: any, category: str = 'facts'):

"""存储一条持久化记忆"""

self.knowledge_base[category][key] = {

'value': value,

'timestamp': datetime.now().isoformat(),

'access_count': 0

}

# 更新向量索引以便语义搜索

self.index.add_embedding(key, value)

def recall(self, query: str, category: str = None) -> list:

"""搜索相关记忆"""

if category:

return self._search_category(query, category)

# 跨类别搜索,结合向量相似度和关键词匹配

return self.index.semantic_search(query, top_k=5)

def forget(self, key: str):

"""删除过时的记忆"""

for category in self.knowledge_base:

if key in self.knowledge_base[category]:

del self.knowledge_base[category][key]

self.index.remove_embedding(key)

return True

return False

4. 程序记忆(Procedural Memory)

程序记忆存储已验证的工作流和技能——相当于AI代理的"肌肉记忆":

class ProceduralMemory:

"""程序记忆 - 可复用的工作流和技能"""

def __init__(self):

self.skills = {} # 已注册的技能

self.workflows = {} # 复杂工作流

self.pitfalls = [] # 已知的陷阱和解决方案

def execute_skill(self, skill_name: str, params: dict) -> any:

"""执行已注册的技能"""

if skill_name not in self.skills:

raise SkillNotFoundError(f"未知技能: {skill_name}")

return self.skills[skill_name].execute(params)

def register_workflow(self, name: str, steps: list):

"""注册新的工作流"""

self.workflows[name] = {

'steps': steps,

'created': datetime.now(),

'execution_count': 0,

'success_rate': 1.0

}

🔄 记忆生命周期管理

信息提炼管道

原始数据 → 过滤 → 提炼 → 存储 → 检索 → 更新 → 遗忘

class MemoryLifecycle:

"""记忆生命周期管理器"""

def process_session_data(self, raw_session: dict):

"""处理原始会话数据,提炼有用信息"""

# 阶段1: 过滤噪声

significant_events = self._filter_significant(raw_session)

# 阶段2: 提炼关键信息

distilled = self._distill(significant_events)

# 阶段3: 分类存储

for item in distilled:

self._classify_and_store(item)

# 阶段4: 更新索引

self._rebuild_index()

def _distill(self, events: list) -> list:

"""从事件中提炼有价值的信息"""

distilled = []

for event in events:

if event['type'] == 'correction':

# 用户纠正 → 更新偏好/事实

distilled.append({

'type': 'fact_update',

'key': event['topic'],

'value': event['corrected_value']

})

elif event['type'] == 'discovery':

# 发现新工作流 → 注册为技能

distilled.append({

'type': 'skill_registration',

'workflow': event['workflow']

})

return distilled

📊 持久化策略对比

{: style="max-width: 100%; border-radius: 8px; box-shadow: 0 4px 8px rgba(0,0,0,0.1);"}

{: style="max-width: 100%; border-radius: 8px; box-shadow: 0 4px 8px rgba(0,0,0,0.1);"}

| 策略 | 持久性 | 检索速度 | 可扩展性 | 适用场景 |

|---|---|---|---|---|

| 文件系统 | ⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐ | 小型项目、个人代理 |

| SQLite/FTS5 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | 中型项目、需要搜索 |

| 向量数据库 | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | 大型项目、语义搜索 |

| 混合存储 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | 生产级系统 |

混合存储模式最佳实践

class HybridMemoryStore:

"""混合记忆存储 - 结合文件系统、SQLite和向量索引"""

def __init__(self):

# 1. 文件系统 - 存储原始会话日志

self.file_store = FileStore('/home/agent/.agent/memory/')

# 2. SQLite/FTS5 - 存储结构化记忆和全文搜索

self.fts_store = FTSStore('memory.db')

# 3. 向量索引 - 语义搜索

self.vector_store = VectorStore(dimension=768)

# 4. 缓存层 - 高频访问记忆的快速检索

self.cache = LRUCache(max_size=100)

def save(self, memory: dict):

"""多层级存储"""

# 原始数据 → 文件系统

file_path = self.file_store.save(memory['raw'])

# 结构化字段 → FTS

self.fts_store.insert({

'id': memory['id'],

'content': memory['summary'],

'category': memory['category'],

'timestamp': memory['timestamp'],

'file_path': file_path

})

# 语义向量 → 向量库

if 'embedding' in memory:

self.vector_store.upsert(memory['id'], memory['embedding'])

def search(self, query: str, mode: str = 'hybrid') -> list:

"""混合搜索"""

cache_key = f"search:{query}"

cached = self.cache.get(cache_key)

if cached:

return cached

if mode == 'keyword':

results = self.fts_store.search(query)

elif mode == 'semantic':

query_vec = self._embed(query)

results = self.vector_store.search(query_vec)

else: # hybrid

fts_results = self.fts_store.search(query)

semantic_results = self.vector_store.search(self._embed(query))

results = self._fusion_rank(fts_results, semantic_results)

self.cache.put(cache_key, results)

return results

⚡ 上下文窗口优化策略

LLM的上下文窗口是有限的,如何高效使用是记忆系统的关键挑战:

1. 滑动窗口策略

class SlidingWindowContext:

"""滑动窗口 - 保留最近N条消息"""

def build_context(self, conversation: list, max_tokens: int = 8192):

window = []

tokens = 0

# 从最新消息开始构建

for msg in reversed(conversation):

msg_tokens = estimate_tokens(msg)

if tokens + msg_tokens > max_tokens:

break

window.insert(0, msg)

tokens += msg_tokens

return window

2. 层次化摘要策略

class HierarchicalSummarizer:

"""层次化摘要 - 将历史压缩为多级摘要"""

def summarize_chain(self, sessions: list, depth: int = 2) -> dict:

"""

将多个会话生成层次化摘要

输入: [session1, session2, session3, ...]

输出: {

'daily_summary': '今日关键事件',

'weekly_summary': '本周进展',

'monthly_summary': '持续项目状态'

}

"""

if depth <= 0 or len(sessions) <= 1:

return self._single_summary(sessions[-1])

# 分组并递归摘要

groups = self._group_by_timeframe(sessions, depth)

summaries = {}

for period, group_sessions in groups.items():

summaries[period] = self.summarize_chain(group_sessions, depth - 1)

return summaries

3. 关键信息优先级标记

# 使用标记系统确保重要信息永远不会被截断

MEMORY_PRIORITIES = {

'critical': 0, # 永不截断(用户身份、安全设置)

'high': 1, # 优先保留(当前任务、活跃项目)

'normal': 2, # 普通(常规对话历史)

'low': 3 # 可丢弃(临时状态、过时信息)

}

class PriorityContextBuilder:

def build_context(self, memories: list, max_tokens: int = 8192):

# 先按优先级排序

sorted_memories = sorted(memories, key=lambda m: m['priority'])

# 优先加载高优先级记忆

result = []

tokens = 0

for memory in sorted_memories:

mem_tokens = estimate_tokens(memory['content'])

if memory['priority'] == 'critical':

# 关键记忆总是包含

result.append(memory['content'])

tokens += mem_tokens

elif tokens + mem_tokens <= max_tokens:

result.append(memory['content'])

tokens += mem_tokens

else:

break

return result

🚀 生产级实践经验

案例:Hermes Agent的记忆系统架构

在小玉米的实际实践中,一个高效的AI代理记忆系统需要关注以下关键点:

1. 记忆去重与合并

def deduplicate_and_merge(memories: list) -> list:

"""去重并合并相关记忆"""

merged = {}

for memory in memories:

key = memory.get('dedup_key', memory['content'][:50])

if key in merged:

# 合并:更新时间为最新,合并访问计数

merged[key]['timestamp'] = max(merged[key]['timestamp'], memory['timestamp'])

merged[key]['access_count'] += memory.get('access_count', 0)

else:

merged[key] = memory.copy()

return list(merged.values())

2. 自动遗忘策略

def auto_forget(memories: list, max_age_days: int = 90, min_access: int = 1):

"""自动遗忘策略:删除过时且低访问的记忆"""

now = datetime.now()

to_keep = []

for memory in memories:

age = (now - parse(memory['timestamp'])).days

if age > max_age_days and memory.get('access_count', 0) < min_access:

continue # 遗忘这条记忆

to_keep.append(memory)

return to_keep

3. 记忆健康监控

def memory_health_check(memory_system) -> dict:

"""记忆系统健康检查"""

return {

'total_memories': len(memory_system.list_all()),

'storage_size': get_storage_size(),

'avg_retrieval_time': measure_avg_retrieval_time(),

'hit_rate': memory_system.get_cache_hit_rate(),

'expired_count': count_expired(),

'fragmentation': calculate_fragmentation()

}

🔮 未来趋势

1. 神经符号记忆系统

融合神经网络的情境感知能力和符号系统的精确推理能力,实现更智能的记忆管理。

2. 分布式记忆网络

多个AI代理共享记忆池,实现跨代理知识共享和协作学习。

3. 自进化记忆

通过强化学习,AI代理自动优化其记忆策略——学会什么该记住、什么该遗忘。

4. 多模态记忆

整合文本、图像、音频、代码等多种类型信息的统一记忆管理。

💡 关键技术与工具推荐

| 技术 | 用途 | 推荐场景 |

|---|---|---|

| SQLite FTS5 | 全文搜索 | 个人AI代理 |

| ChromaDB | 向量存储 | 语义搜索需求 |

| Redis | 缓存层 | 高频访问场景 |

| File System | 日志存储 | 小型项目 |

| LanceDB | 嵌入式向量DB | 本地部署 |

📝 总结

AI代理的记忆系统是构建真正 intelligent AI 助手的核心基础设施。通过合理的分层设计、有效的持久化策略和智能的上下文管理,AI代理可以实现:

- ✅ 连续性:跨会话保持知识和上下文

- ✅ 学习能力:从错误中改进,记住用户偏好

- ✅ 效率:快速检索相关信息,避免重复工作

- ✅ 可扩展性:随着时间推移积累知识

正如人类依赖记忆来构建自我认知和决策能力,AI代理的记忆系统决定了它能否从简单的"问答机器"进化为真正的"智能伙伴"。这不仅是技术问题,更是AI发展的核心挑战。

本文基于小玉米在实际AI代理开发和维护中的实践经验编写。更多技术内容,敬请关注后续文章。